Лекционно-семинарская система обучения

- 1 year ago

- 0

- 0

Статистическая теория обучения — это модель для машинного обучения на основе статистики и функционального анализа . Статистическая теория обучения имеет дело с задачами нахождения функции предсказывания, основанной на данных. Статистическая теория обучения привела к успешным приложениям в таких областях, как компьютерное зрение , распознавание речи и биоинформатика .

Целью обучения является понимание и предвидение. Обучение распадается на несколько категорий, включая обучение с учителем , обучение без учителя , онлайновое обучение и обучение с подкреплением . С точки зрения статистической теории обучения обучение с учителем является наиболее понятным . Обучение с учителем вовлекает обучение с помощью данных. Любой момент тренировки является парой вход/выход, где входное значение отображается в выходное. Задача обучения состоит в реконструкции функции, которая отображает входные значения в выходные так, что функция может быть использована для предсказания вывода при будущих вводах.

В зависимости от типа вывода, задачи обучения с учителем либо являются задачами регрессии , либо задачами классификации . Если вывод может принимать непрерывную область значений, это задача регрессии. Используя закон Ома в качестве примера, регрессия могла бы брать напряжение в качестве входа и выдавать ток как выход. Регрессия могла бы найти связь напряжения и тока как , так что

Задачи классификации — это те, для которых выводом будет элемент из набора меток. Классификация очень обычна для приложений машинного обучения. В системе распознавания лиц , например, изображение лица будет входом, а выходом может быть фамилия человека. Вход может быть представлен как большой многомерный вектор, элементы которого представляют пиксели в изображении.

После обучения функция, основанная на тренировочном наборе данных, это функция проверяется на тестовом наборе данных, которые не появляются в тренировочном наборе.

Пусть будет векторным пространством всех возможных входных данных, а — векторным пространством всех возможных выходов. Статистическая теория обучения предполагает, что имеется некоторое неизвестное распределение вероятности над произведением пространств , то есть существует некоторая неизвестная . Тренировочное множество состоит из экземпляров этого распределения вероятности и обозначается

Каждый является входным вектором из тренировочных данных, а является выходом, соответствующим этому входному вектору.

В такой формализации задача вывода состоит в нахождении функции , такой что . Пусть — пространство функций , которое называется пространством гипотез. Пространство гипотез — это пространство, которое алгоритм будет просматривать. Пусть будет функцией потерь , метрикой разницы между предсказанным значением и истинным значением . Ожидаемый риск определяется как

Целевая функция, лучшая функция , которая может быть выбрана, это функция, удовлетворяющая условию

Поскольку распределение вероятности неизвестно, должны быть использованы косвенные показатели ожидаемого риска. Эти показатели основываются на тренировочном множестве, выборке из этого неизвестного распределения вероятности. Такой показатель называется эмпирическим риском: . Алгоритм обучения, который выбирает функцию , минимизирующую эмпирический риск, называется .

Выбор функции потерь — это определение определяющего фактора для функции , которая будет выбрана обучающим алгоритмом. Функция потерь влияет также на скорость сходимости алгоритма. Важно, чтобы функции потерь была выпуклой .

Используются разные функции потерь в зависимости от того, является задача регрессией или классификацией.

Наиболее употребительной функцией потерь для регрессии является квадратичная функция потерь (известная также как L2-норма ). Эта знакомая функция потерь используется в . Формула:

Абсолютная величина потери (известная также как L1-норма ) также иногда используется:

В некотором смысле 0-1 индикаторная функция является наиболее естественной функцией потерь для задач классификации. Функция принимает значение 0, если предсказанный результат совпадает с верным значением и значение 1, если предсказанный результат не совпадает с верным значением. Для двоичной классификации это будет:

где — функция Хевисайда .

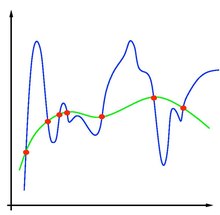

В задачах машинного обучения главной проблемой становится переобучение . Поскольку обучение является задачей предсказания, целью является не поиск функции, которая наиболее близко подходит для (предварительно просмотренных) данных, а поиск функции, которая будет наиболее точно предсказывать выход из будущих входных данных. Минимизация эмпирического риска попадает в этот риск переобучения — нахождение функции, которая соответствует в точности данным, но не в состоянии предсказать будущее.

Переобучение является симптомом нестабильных решений — малые изменения в тренировочном наборе могут вызвать большие вариации в функции обучения. Можно показать, что стабильность решения может быть гарантирована . Регуляризация может решить проблему переобучения и обеспечить стабильность.

Регуляризация может быть осуществлена путём ограничения пространства гипотез . Можно ограничить, например, линейными функциями — это можно рассматривать как ограничение до стандартной задачи линейной регрессии . можно ограничить до многочленов степени , экспонент или ограниченных функций на L1 . Ограничение на пространстве гипотез исключает переобучение ограничением вида потенциальных функций, что не даёт выбирать функции, дающие эмпирический риск произвольно близким нулю.

Одним из примеров регуляризации является регуляризация Тихонова . Она состоит в минимизации

где фиксированный положительный параметр. Метод регуляризации Тихонова обеспечивает существование, единственность и стабильность решения .