Interested Article - Байесовская сеть

- 2021-05-22

- 1

Байесовская сеть (или байесова сеть , байесовская сеть доверия , англ. Bayesian network, belief network ) — графовая вероятностная модель , представляющая собой множество переменных и их вероятностных зависимостей по Байесу . Например, байесовская сеть может быть использована для вычисления вероятности того, чем болен пациент, по наличию или отсутствию ряда симптомов, основываясь на данных о зависимости между симптомами и болезнями. Математический аппарат байесовых сетей создан американским учёным Джудой Перлом , лауреатом Премии Тьюринга (2011).

Формально, байесовская сеть — это ориентированный ациклический граф , каждой вершине которого соответствует случайная переменная, а дуги графа кодируют отношения условной независимости между этими переменными. Вершины могут представлять переменные любых типов, быть взвешенными параметрами, скрытыми переменными или гипотезами. Существуют эффективные методы, которые используются для вычислений и обучения байесовских сетей. Если переменные байесовской сети являются дискретными случайными величинами, то такая сеть называется дискретной байесовской сетью. Байесовские сети, которые моделируют последовательности переменных, называют . Байесовские сети, в которых могут присутствовать как дискретные переменные, так и непрерывные, называются . Байесовская сеть, в которой дуги помимо отношений условной независимости кодируют также отношения причинности , называют ( англ. causal bayesian networks ) ).

Определения и принципы работы

Если из вершины выходит дуга в вершину , то называют родителем , а называют потомком . Если из вершины существует ориентированный путь в вершину , то называется предком , а называется потомком .

Множество вершин-родителей вершины обозначим как .

Направленный ациклический граф называется байесовской сетью для вероятностного распределения , заданного над множеством случайных переменных , если каждой вершине графа поставлена в соответствие случайная переменная из , а дуги в графе удовлетворяют условию (марковское условие ): любая переменная из должна быть условно независима от всех вершин, не являющихся её потомками, если заданы (получили означивание, обусловлены) все её прямые родители в графе , то есть

справедливо:

где — значение ; — конфигурация [ уточнить ] ; — множество всех вершин, не являющихся потомками ; — конфигурация .

Тогда полное совместное распределение значений в вершинах можно удобно записать в виде декомпозиции (произведения) локальных распределений:

Если у вершины нет предков, то её локальное распределение вероятностей называют безусловным , иначе условным . Если вершина — случайная переменная получила означивание (например, в результате наблюдения), то такое означивание называют свидетельством ( англ. evidence ). Если значение переменной было установлено извне (а не наблюдалось), то такое означивание называется вмешательством ( англ. action ) или интервенцией ( англ. intervention ) .

Условная независимость в байесовской сети представлена графическим свойством d-разделённости .

d-разделённость

Путь называют d-разделённым ( англ. d-separated ), или блокированным ( англ. blocked ) множеством вершин тогда и только тогда, когда

- содержит цепь или разветвление такие, что принадлежит , или

- содержит инвертированное разветвление (коллайдер) , такое, что не принадлежит и у вершины нет потомков, которые принадлежат .

Пусть — непересекающиеся подмножества вершин в ацикличном ориентированном графе . Говорят, что множество вершин d-разделяет и тогда и только тогда, когда блокирует все пути из любой вершины, принадлежащей в любую вершину, принадлежащую , и обозначают . Под путём понимается последовательность следующих друг за другом рёбер (любого направления) в графе .

Теорема о d-разделённости

Для любых трёх непересекающихся подмножеств вершин в ацикличном ориентированном графе и для всех вероятностных распределений справедливо:

- если , то , если и марковски совместимы, и

- если отношение условной независимости выполняется для всех вероятностных распределений, Марковски-совместимых с , то из этого следует .

Другими словами, если вершины d-разделены, то они условно независимы; и если вершины условно-независимы во всех вероятностных распределениях, совместимых с графом , то они d-разделены .

( означает, что множества переменных и условно-независимы при заданном множестве .)

Свидетельства

Свидетельства — утверждения вида «событие в узле x произошло». Например: «компьютер не загружается» .

Вероятностные запросы

Байесовская сеть позволяет получить ответы на следующие типы вероятностных запросов :

- нахождение вероятности свидетельства,

- определение априорных маргинальных вероятностей,

- определение апостериорных маргинальных вероятностей, включая:

- прогнозирование , или прямой вывод , — определение вероятности события при наблюдаемых причинах,

- диагностирование , или обратный вывод ( абдукция ), — определение вероятности причины при наблюдаемых следствиях,

- межпричинный (смешанный) вывод ( англ. intercausal inference ) или трансдукция , — определение вероятности одной из причин наступившего события при условии наступления одной или нескольких других причин этого события.

- вычисление наиболее вероятного объяснения наблюдаемого события ( англ. most probable explanation , MPE ),

- вычисление апостериорного максимума ( англ. maximum a-posteriori, MAP ).

Пример

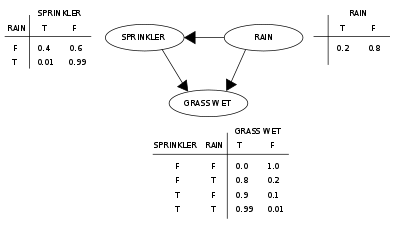

Предположим, что может быть две причины, по которым трава может стать мокрой (GRASS WET): сработала дождевальная установка, либо прошёл дождь. Также предположим, что дождь влияет на работу дождевальной машины (во время дождя установка не включается). Тогда ситуация может быть смоделирована проиллюстрированной байесовской сетью. Каждая из трёх переменных может принимать лишь одно из двух возможных значений: T (правда — true) и F (ложь — false), с вероятностями, указанными в таблицах на иллюстрации.

Совместная вероятность функции:

где имена трёх переменных означают G = Трава мокрая (Grass wet) , S = Дождевальная установка (Sprinkler) , и R = Дождь (Rain) .

Модель может ответить на такие вопросы как «Какова вероятность того, что прошел дождь, если трава мокрая?» используя формулу условной вероятности и суммируя переменные:

Вероятностный вывод

В силу того, что байесовская сеть — это полная модель для переменных и их отношений, она может быть использована для того, чтобы давать ответы на вероятностные вопросы. Например, сеть можно использовать, чтобы получить новое знание о состоянии подмножества переменных, наблюдая за другими переменными (переменные- свидетельства ). Это процесс вычисления апостериорного распределения переменных по переменным- свидетельствам называют вероятностным выводом. Это следствие даёт нам универсальную оценку для приложений, где нужно выбрать значения подмножества переменных, которое минимизирует функцию потерь, например, вероятность ошибочного решения. Байесовская сеть может также считаться механизмом для автоматического построения расширения теоремы Байеса для более сложных задач.

Для проведения вероятностного вывода в байесовских сетях используются следующие алгоритмы :

-

Точные:

- вывод методом грубой силы путём маргинализации полного совместного распределения;

- алгоритмы устранения переменных и символьные вычисления,

- кластеризация,

- алгоритмы пропагации (передача) сообщений между узлами сети,

-

Приближённые на основе

метода Монте-Карло

:

- алгоритмы формирования выборок с исключением,

- метод оценки выборок с учётом правдоподобия,

- алгоритм ( англ. Markov chain Monte Carlo ) и др.

Приложения

Байесовские сети используются для моделирования в биоинформатике ( , структура белков ), медицине , классификации документов , обработке изображений , , машинном обучении и системах поддержки принятия решений .

Дополнительная информация

- Association for Uncertainty in Artificial Intelligence: от 2 июня 2007 на Wayback Machine

- Введение в байесовские сети: от 21 мая 2017 на Wayback Machine

- On-line Tutorial on Bayesian nets and probability: от 4 мая 2009 на Wayback Machine

- Сергей Николенко. Лекции от 29 декабря 2009 на Wayback Machine , от 1 января 2015 на Wayback Machine и от 1 января 2015 на Wayback Machine , посвящённые байесовским сетям доверия. Курс

Бесплатные и свободные программные продукты

- OpenBayes (contains a patched build of OpenBayes from openbayes.org)

- RISO: от 4 марта 2007 на Wayback Machine (distributed belief networks)

- от 20 июля 2011 на Wayback Machine — Freeware. From the Non Linear Dynamics Laboratory. Mathematics Department, Science School, UNAM.

- SamIam: от 24 апреля 2007 на Wayback Machine

Коммерческие программные продукты

- AgenaRisk Bayesian network tool: от 16 марта 2022 на Wayback Machine

- BayesFusion (GeNIe и SMILE): от 29 ноября 2018 на Wayback Machine

- Bayesian network application library: от 11 июня 2007 на Wayback Machine

- Bayesia: от 8 марта 2022 на Wayback Machine

- Hugin: от 30 мая 2020 на Wayback Machine

- Netica: от 20 мая 2007 на Wayback Machine

- BNet: от 5 июля 2008 на Wayback Machine

- Dezide: от 8 марта 2022 на Wayback Machine

- MSBNx: a component-centric toolkit for modeling and inference with Bayesian Network (from Microsoft Research ): от 29 ноября 2018 на Wayback Machine

- Bayes Net Toolbox for Matlab: от 10 мая 2007 на Wayback Machine

- dVelox: от 29 ноября 2018 на Wayback Machine

- SIAM & Causeway:

См. также

Примечания

- ↑ Judea Pearl. Causality: Models, Reasoning, and Inference. — 2-nd Edition. — Cambridge University Press, 2009. — 464 p. — ISBN 9780521895606 .

- Adnan Darwiche. Modeling and Reasoning with Bayesian Networks. — Cambridge University Press, 2009. — 526 p. — ISBN 978-0521884389 .

- Стюарт Рассел, Питер Норвиг. Искусственный интеллект: современный подход (AIMA): [пер. с англ.]. — 2-е изд. — М.: Вильямс, 2005. — 1424 p.

Ссылки

- Jensen, Finn V. (англ.) . — Springer , 2001.

- Judea Pearl, Stuart Russell. Bayesian Networks. UCLA Cognitive Systems Laboratory, Technical Report (R-277), November 2000.

- Judea Pearl, Stuart Russell. Bayesian Networks, in M. A. Arbib (Ed.), Handbook of Brain Theory and Neural Networks , pp. 157—160, Cambridge, MA: MIT Press , 2003, ISBN 0-262-01197-2 .

- Neil M, Fenton N, Tailor M, «Using Bayesian Networks to model Expected and Unexpected Operational Losses», Risk Analysis: An International Journal, Vol 25(4), 963—972, 2005. от 27 сентября 2007 на Wayback Machine

- Enrique Castillo, José Manuel Gutiérrez, and Ali S. Hadi. Expert Systems and Probabilistic Network Models . New York: Springer-Verlag , 1997. ISBN 0-387-94858-9

- Fenton NE and Neil M, «Combining evidence in risk analysis using Bayesian Networks».

- Judea Pearl. Fusion, propagation, and structuring in belief networks. Artificial Intelligence 29 (3):241—288, 1986.

- Pearl, Judea . (англ.) . — Morgan Kaufmann , 1988. — ISBN 0-934613-73-7 .

- Judea Pearl. Causality. 2000.

- J.W. Comley and от 12 февраля 2006 на Wayback Machine , « от 4 августа 2016 на Wayback Machine », (pp от 27 сентября 2016 на Wayback Machine — от 27 сентября 2016 на Wayback Machine ) in P. Grunwald, M.A. Pitt and I.J. Myung (eds)., от 19 июня 2006 на Wayback Machine , Cambridge, MA: MIT Press , April 2005, ISBN 0-262-07262-9 . (This paper puts in internal nodes of Bayes networks using от 9 февраля 2006 на Wayback Machine ( ). An earlier version is от 4 августа 2016 на Wayback Machine , от 10 февраля 2006 на Wayback Machine .)

- Christian Borgelt and Rudolf Kruse. от 10 июня 2007 на Wayback Machine , Chichester, UK: Wiley , 2002, ISBN 0-470-84337-3

- Korb, Kevin B.; Ann E Nicholson. (англ.) . — CRC Press , 2004. — ISBN 1-58488-387-1 . от 10 апреля 2007 на Wayback Machine

- от 7 июня 2007 на Wayback Machine and от 10 июня 2007 на Wayback Machine , от 17 апреля 2007 на Wayback Machine , Proceedings of the Tenth Biennial Canadian Artificial Intelligence Conference (AI-94), Banff, May 1994, 171—178. This paper presents variable elimination for belief networks.

- от 30 мая 2007 на Wayback Machine , от 19 июля 2006 на Wayback Machine . In Learning in Graphical Models, M. Jordan, ed. MIT Press, Cambridge, MA, 1999. Also appears as Technical Report MSR-TR-95-06, Microsoft Research, March, 1995. An earlier version appears as Bayesian Networks for Data Mining, Data Mining and Knowledge Discovery, 1:79-119, 1997. The paper is about both parameter and structure learning in Bayesian networks.

- 2021-05-22

- 1